visionOS 26, dévoilé lors de la WWDC 2025, redéfinit l’expérience immersive sur Apple Vision Pro.

Cette nouvelle version du système spatial introduit des widgets persistants dans l’espace, des Personas plus humains que jamais, et une compatibilité élargie avec de nouveaux périphériques comme les manettes PS VR2. En parallèle, Apple renforce les usages professionnels et partagés dans un écosystème toujours plus connecté. Voici tout ce qu’il faut retenir.

Widgets ancrés : une interface adaptée à l’espace

Avec visionOS 26, Apple enrichit l’interaction en réalité mixte en introduisant des widgets spatiaux. Ces éléments ne sont plus simplement flottants : ils peuvent désormais être ancrés dans votre environnement. Vous pouvez, par exemple, fixer une horloge au mur de votre salon, placer la météo près d’une fenêtre ou garder vos notes visibles en permanence. Ces widgets restent en place d’une session à l’autre, offrant une continuité et une personnalisation accrues. Une application dédiée permet de les organiser, et les développeurs peuvent en créer de nouveaux via WidgetKit. C’est une avancée importante vers un espace de travail personnel, persistant et contextuel.

Ergonomie et continuité : iPhone, Mac et Vision Pro main dans la main

Le Vision Pro devient un maillon à part entière de l’écosystème Apple. visionOS 26 permet par exemple de déverrouiller automatiquement l’iPhone lorsqu’on porte le casque, ou encore de répondre à un appel reçu sur l’iPhone directement dans l’interface immersive. Le Control Center a été repensé pour afficher plusieurs comptes utilisateurs, les modes Focus, ou la connexion rapide à un Mac virtuel.

La nouvelle Home View permet de mieux organiser ses apps et widgets grâce à la création de dossiers spatiaux. Apple annonce également la prise en charge de nouvelles langues, dont le français, l’allemand et le japonais.

Personas & Spatial Scenes : vers une présence numérique réaliste

Les Personas, avatars numériques de l’utilisateur, prennent une nouvelle dimension avec visionOS 26. Grâce à l’intégration de techniques avancées de rendu volumétrique et d’IA, ils gagnent en fidélité : textures de peau plus naturelles, cils modélisés, cheveux dynamiques, expressions faciales précises, et même un rendu en profil latéral. Cela améliore sensiblement les interactions en FaceTime et les collaborations immersives.

visionOS 26 introduit également les Scènes Spatiales, une évolution des Photos Spatiales qui renforce le réalisme et la sensation d’immersion. Grâce à un nouvel algorithme génératif basé sur l’intelligence artificielle, combiné à l’analyse de la profondeur de champ, ces scènes offrent plusieurs angles de vue à partir d’une simple image. L’utilisateur peut bouger légèrement la tête pour percevoir la scène sous différents angles, ce qui renforce la profondeur et donne une impression plus réaliste.

Collaboration & entreprise : partage spatial et sécurité intégrée

Apple améliore la co‑présence immersive grâce aux expériences spatiales partagées. Il est désormais possible de regarder un film, jouer à un jeu ou collaborer dans une app spatialisée avec plusieurs utilisateurs présents dans la même pièce, chacun avec son propre Vision Pro. La fonctionnalité reste disponible à distance via FaceTime. C’est une avancée majeure pour les usages familiaux, pédagogiques ou professionnels.

Dans le cadre professionnel, visionOS 26 intègre de nouvelles API dédiées aux entreprises. Parmi elles : des outils de gestion de flotte pour déployer et administrer plusieurs Apple Vision Pro, une meilleure synchronisation avec les iPhone utilisés en environnement professionnel, ainsi qu’une API de protection de contenu pour sécuriser les données sensibles (Protected Content API).

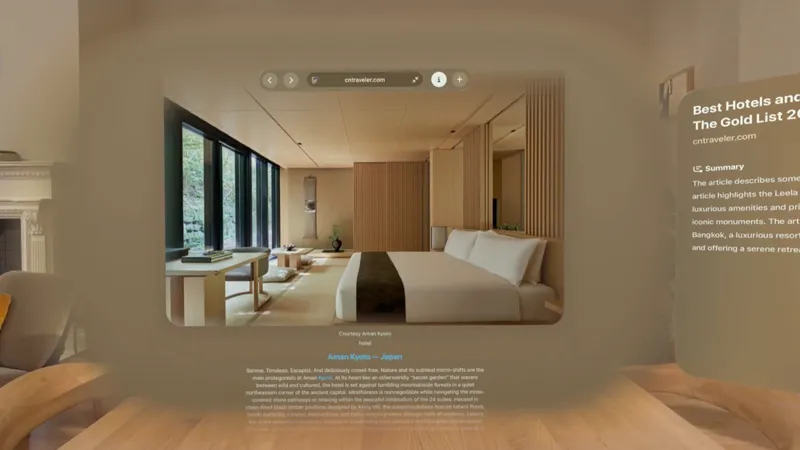

Navigation par le regard & Safari spatial : un Web repensé pour la XR

Parmi les nouveautés de visionOS 26, le Look-to-Scroll nous permet de faire défiler du contenu uniquement avec le mouvement des yeux. Une fois activée, cette fonction donne à l’utilisateur la possibilité de lire un article, parcourir une galerie ou naviguer dans une app sans lever le doigt, avec une précision ajustable dans les réglages système. Cette fonction renforce l’aspect mains-libres du Vision Pro.

Côté web, Safari se spatialise avec une navigation immersive, en limitant les distractions et en faisant apparaître des scènes spatiales qui s’animent au fil du défilement. Les développeurs peuvent désormais intégrer des modèles 3D directement dans leurs pages, rendant les sites plus interactifs et riches. Le navigateur devient alors une sorte de showroom ou de galerie immersive, permettant de découvrir des produits, objets ou lieux en 360°.

Accessoires compatibles : PS VR2, Logitech Muse

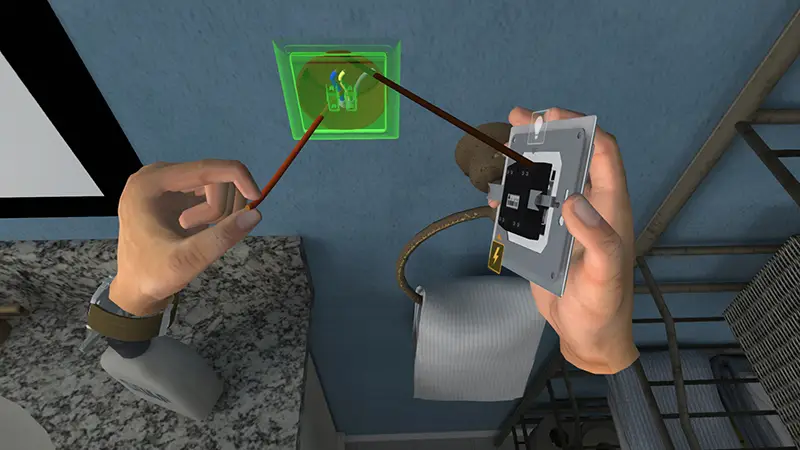

visionOS 26 marque une ouverture importante de l’écosystème Apple vers des périphériques tiers. Les manettes PS VR2 Sense de Sony deviennent compatibles avec le Vision Pro, ouvrant la voie à des jeux plus immersifs grâce à leur retour haptique et tracking 6DoF. C’est une alliance inattendue mais stratégique, confirmée par Apple et Sony lors de la keynote.

Côté productivité et créativité, le Logitech Muse fait aussi son entrée. Ce stylet spatial permet de dessiner, pointer, annoter ou interagir avec précision dans les apps compatibles (maquettes 3D, design produit, éducation).

Disponibilité de visionOS 26

La version développeur de visionOS 26 est disponible depuis le 9 juin 2025. Une bêta publique est attendue pour juillet pour les autres OS (iOS, iPadOS, macOS), mais visionOS reste pour l’instant réservé aux développeurs enregistrés. Le lancement officiel est prévu pour l’automne 2025.